La Comisión Europea ha puesto en marcha la aplicación práctica del artículo 50 del Reglamento de Inteligencia Artificial con una consulta pública -ya concluida-, centrada en cómo detectar y etiquetar contenidos generados por sistemas de IA. El objetivo es definir directrices y un código de buenas prácticas que garanticen la transparencia y la información al usuario antes de 2026.

El 4 de septiembre la Comisión Europea lanzó una consulta pública que finalizó el pasado 9 de octubre sobre la aplicación del artículo 50 del Reglamento de Inteligencia Artificial (RIA). Esta norma, en vigor desde el 1 de agosto de 2024, establece obligaciones de transparencia que comenzarán a aplicarse a partir del 2 de agosto de 2026.

¿El objetivo de la consulta?

Recabar opiniones sobre cómo detectar y etiquetar los contenidos generados o manipulados por sistemas de IA, y garantizar que los usuarios estén informados cuando interactúan con ellos. Para ello, se plantean ejemplos prácticos, como qué técnicas de marcado (watermarks, metadatos, etc.) resultan más eficaces, cuándo puede considerarse obvia la intervención de una IA (y, por tanto, no requerir aviso) o cómo informar del carácter artificial de los deepfakes en obras creativas.

La consulta servirá para elaborar dos instrumentos clave: unas directrices prácticas que cubran todo el artículo 50 y un código de buenas prácticas centrado en los sistemas generativos. Las directrices aportarán claridad jurídica; el código, soluciones técnicas concretas. La idea es proporcionar a proveedores y usuarios una hoja de ruta común práctica para cumplir con las obligaciones de transparencia antes de 2026.

¿Qué exige el artículo 50 del RIA?

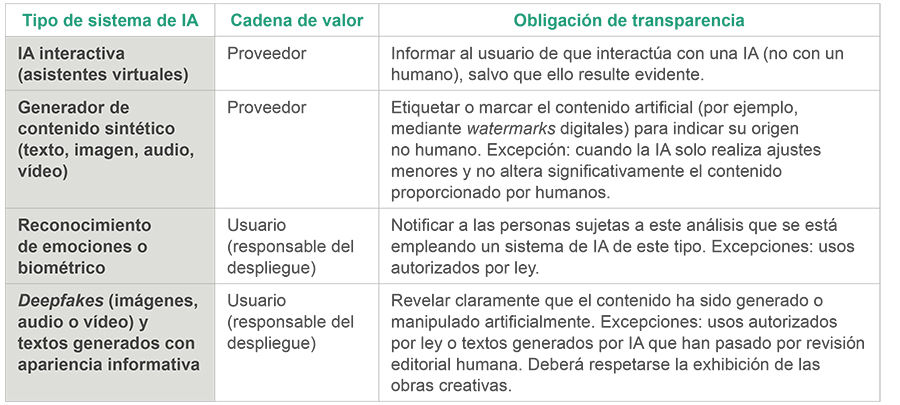

Este artículo establece varias obligaciones de transparencia para los proveedores y usuarios (responsables del despliegue) de cuatro categorías de sistemas de IA:

Aunque el reglamento exige que la información se presente de forma clara, accesible y distinguible, no especifica cómo hacerlo. De ahí la importancia de esta consulta.

¿Qué implicaciones prácticas tiene?

- Estándares técnicos para la industria: se espera que del proceso surjan estándares sobre cómo marcar contenidos generados por IA. Se barajan opciones tecnológicas como watermarks invisibles integrados en imágenes/vídeos, etiquetas en metadatos de archivos, o sistemas de prueba criptográfica de procedencia. Las soluciones deberán ser fiables, interoperables para que diferentes herramientas puedan leerla y resistentes a manipulaciones.

- Mayor transparencia para usuarios y creadores de contenido: para los ciudadanos, estas medidas significarán que, en el futuro, deberían poder distinguir con claridad si un contenido digital ha sido generado por IA. Por ejemplo, una fotografía sintética o un audio de voz clonado llevarán incorporada una señal detectable (pensemos en una marca digital) que permita a redes sociales, medios o incluso al propio usuario verificar su origen. Esto ayudará a combatir la desinformación y los fraudes.

- Carga para proveedores y usuarios de IA: las empresas tecnológicas y creadoras de modelos generativos (por ejemplo, empresas de IA generativa tipo GPT, DALL·E, Midjourney, etc.) deberán adaptar sus productos e incorporar funciones de marcado en sus modelos para cumplir con las nuevas exigencias. Para los usuarios (por ejemplo, medios que usen IA para redactar artículos o estudios que generen contenidos audiovisuales con IA), será crucial seguir las pautas para etiquetar correctamente y en el momento oportuno. Los medios de comunicación también deberán definir protocolos internos sobre cuándo un contenido se considera “humano” o “IA” según el grado de supervisión.

- Impacto en el ámbito creativo: en sectores creativos, las obligaciones de etiquetado de deepfakes también tendrán efectos. Por ejemplo, en producciones audiovisuales que utilicen IA para recrear digitalmente actores o escenarios, se requerirá informar al público de ello. El RIA flexibiliza la forma de hacerlo cuando se trate de obras artísticas o de ficción evidentes –posiblemente bastará con un aviso en los créditos o en la descripción– para no perjudicar la experiencia artística.

¿Y ahora qué?

Con la consulta pública ya cerrada, la Comisión Europea y la Oficina de IA entran en la siguiente fase: analizar las aportaciones recibidas y comenzar la redacción. El proceso arrancará con una sesión plenaria inaugural a principios de noviembre. A partir de ahí, se abrirá un periodo de trabajo colaborativo que se extenderá hasta junio de 2026, fecha límite para tener listo el texto definitivo.

Los instrumentos serán voluntarios, pero quienes se adhieran podrán usarlos como vía para demostrar que cumplen con el artículo 50. En definitiva, el marco está en construcción, las reglas se están afinando y el reloj corre hacia agosto de 2026. ¿Será suficiente lo que se proponga? ¿Se logrará un equilibrio entre innovación y protección? ¿Cómo reaccionará el mercado? Veremos qué pasa. Porque si algo hemos aprendido con la IA, es que todo puede cambiar… y rápido.

Marta Valero